Китайская фирма Xpeng Motors продемонстрировала реалистичного робота-гуманоида IRON, настолько похожего на настоящего человека, что многие зрители начали сомневаться в его подлинности.

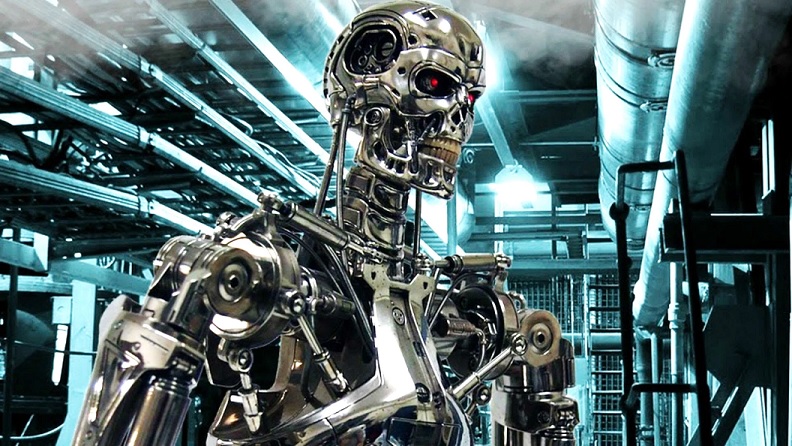

Билл Гейтс: ИИ может выйти из-под контроля и решить, что люди представляют угрозу

Основатель Microsoft Билл Гейтс «вдохновлен» достижениями в области создания искусственного интеллекта (ИИ), но опасается, что «злонамеренные» силы могут использовать роботов для управления миром. Об этом сообщает Daily Star.

Фото из открытых источников

Фото из открытых источников

Билла Гейтса считает, что правительства должны взять под контроль разработку роботов, чтобы остановить «злонамеренные» силы, использующие их для управления миром.

Мультимиллиардер сказал, что он взволнован и вдохновлен достижениями в области создания ИИ, и если их использовать «во благо», то можно повысить уровень образования, здравоохранения, бизнеса и образа жизни, в то же время сокращая глобальное неравенство и бедность.

Однако если ИИ попадут не в те руки, ими могут манипулировать настоящие злодеи в стиле Джеймса Бонда для достижения своих извращенных целей.

Точно так же неконтролируемые сверхинтеллектуальные машины могут «выйти из-под контроля» и решить для себя, что «люди представляют угрозу».

Билл Гейтс не единственный, кто в последнее время предупреждает об опасностях ИИ. Например, режиссер «Терминатора» Джеймс Кэмерон сказал, что роботы, возможно, уже контролируют нас.

Гейтс сказал: «Как и большинство изобретений, искусственный интеллект может использоваться как в благих, так и во вредных целях. Правительствам необходимо работать с частным сектором над способами ограничения рисков. Иначе есть вероятность, что ИИ выйдет из-под контроля».

«Может ли машина решить, что люди представляют угрозу, сделать вывод, что ее интересы отличаются от наших, или просто перестать заботиться о нас?»

Билл сказал, что будут разработаны суперинтеллектуальные ИИ, которые будут думать так быстро, что человеческий мозг по сравнению с ними будет «работать со скоростью улитки».

«Он сможет делать все, что может человеческий мозг, но без каких-либо практических ограничений на размер его памяти или скорость, с которой он работает. Это будет глубокое изменение», - сказал он.

Эти сильные ИИ, как их называют, вероятно, смогут устанавливать свои собственные цели. Каковы будут эти цели? Что произойдет, если они вступят в конфликт с интересами человечества? Должны ли мы пытаться предотвратить разработку сильного ИИ? Со временем эти вопросы станут более актуальными.

Основатель Microsoft также назвал разработку ИИ «захватывающей» и подчеркнул, какую пользу может он принести.

Он добавил: «Мне повезло, что я участвовал в революции ПК и интернет-революции. Я так же взволнован этим моментом. Эта новая технология может помочь людям во всем мире улучшить свою жизнь».

«В то же время миру необходимо установить правила дорожного движения, чтобы любые недостатки искусственного интеллекта намного перевешивали его преимущества, и чтобы каждый мог пользоваться этими преимуществами независимо от того, где он живет или сколько у него денег».

Израильский историк, профессор Еврейского университета Юваль Ной Харари заявил, что темпы развития искусственного интеллекта не только поражают, но и пугают его.

С 1950-х годов человечество ведет поиски внеземной жизни, вооружившись более совершенными..

Примерно 56 миллионов лет назад Земля пережила резкое повышение температуры, которое..