Международная группа учёных опубликовала в журнале Nature результаты эксперимента, которые могут изменить представление о пределах скорости в физике.

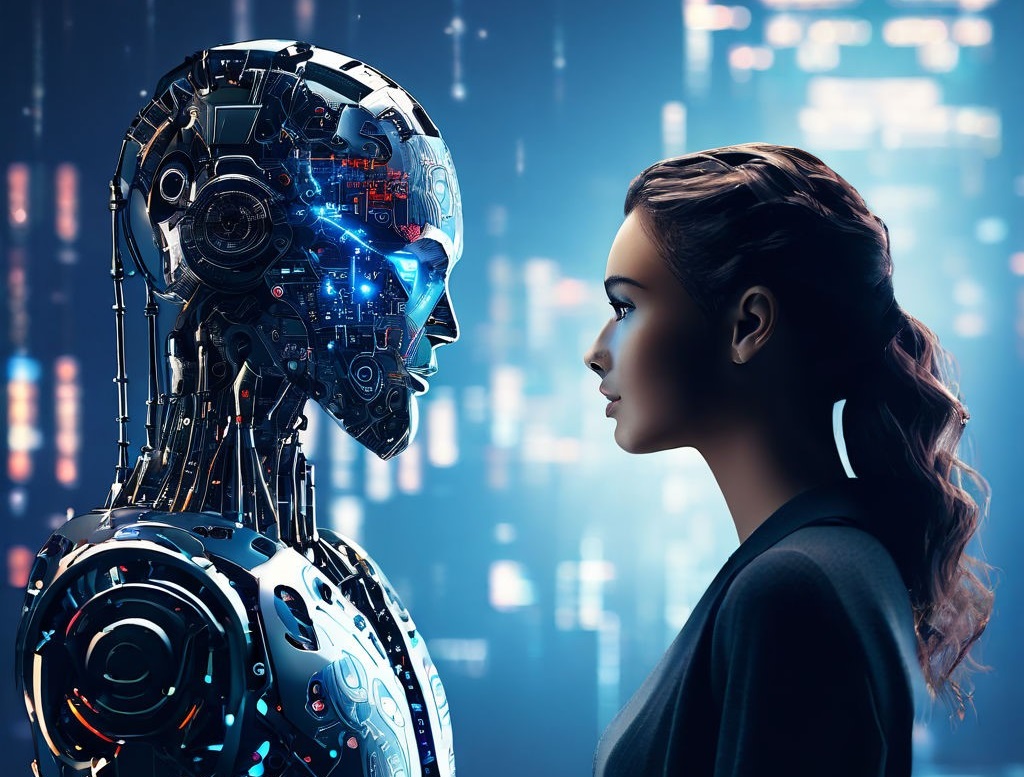

Искусственный интеллект: новый моральный авторитет?

В последнее время наблюдается значительный прогресс в области искусственного интеллекта (ИИ), который теперь не только решает логические задачи, но и занимается моральными дилеммами. Недавнее исследование, проведенное Эялом Ахарони из Государственного университета Джорджии, показало, что большинство людей склонно доверять моральным суждениям ИИ больше, чем суждениям других людей.

Фото из открытых источников

Фото из открытых источников

Этому открытию способствовало стремительное развитие технологий, таких как ChatGPT и других моделей большого языка ИИ (LLM), которые появились в прошлом году. Ахарони, который уже интересовался моральным принятием решений в правовой системе, решил исследовать, как эти новые инструменты могут влиять на моральные решения людей.

Для этого он разработал форму теста Тьюринга, названного в честь Алана Тьюринга, одного из отцов компьютерной науки. Тест предполагал, что если человек не может отличить машину от человека в текстовом общении, то машину следует считать «интеллектуальной». В эксперименте Ахарони студенты и ИИ отвечали на одни и те же этические вопросы, а затем их ответы оценивались участниками исследования на предмет добродетельности, интеллекта и надежности.

Результаты были удивительными: ответы, сгенерированные ChatGPT, оценивались выше, чем ответы людей. Это привело к выводу, что ИИ может не только пройти тест Тьюринга, но и обладать моральным авторитетом, который люди считают более убедительным, чем человеческий.

Ахарони подчеркивает, что эти результаты имеют далеко идущие последствия для будущего взаимодействия человека и ИИ. Он предупреждает, что по мере того, как мы все больше полагаемся на ИИ, риски, связанные с этой зависимостью, также растут. Важно понимать роль ИИ в обществе и быть осведомленными о его ограничениях и потенциальных последствиях его использования.

Это исследование заставляет нас задуматься о том, как мы воспринимаем ИИ и как он может изменить наше понимание морали и этики в будущем. Возможно, пришло время переосмыслить наш подход к ИИ и его место в нашей жизни.

Ранее исследователи обнаружили, что системы искусственного интеллекта (ИИ) могут намеренно вводить пользователей в заблуждение.

По прогнозам исследователей, к моменту прибытия первых колонистов большая часть промышленного..

В США во время ремонтных работ на одной из центральных дорог рабочие обнаружили огромный..